瞄準(zhǔn)AI下一站!360開源視覺語言對齊模型FG-CLIP2,撬動具身智能與商業(yè)增長

分享到微信

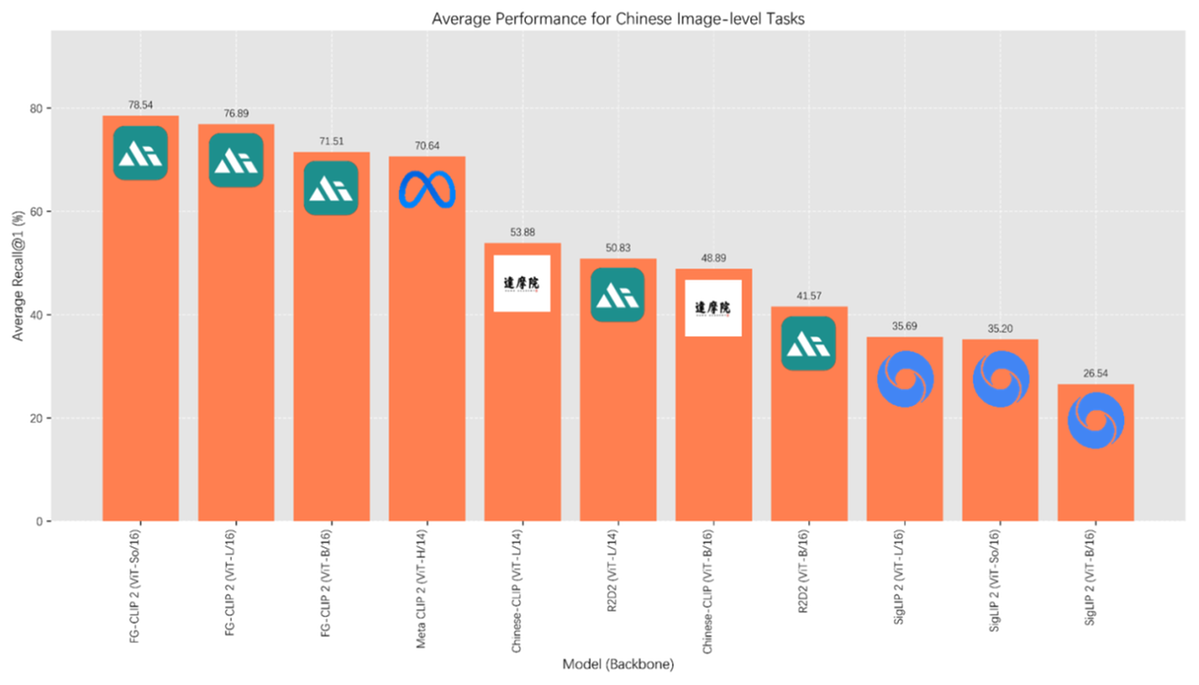

【環(huán)球網(wǎng)科技綜合報道】當(dāng)行業(yè)還在卷大模型參數(shù)時,360已悄然在AI的“視力”上實(shí)現(xiàn)了降維打擊。其最新開源的FG-CLIP2模型,憑借對圖像細(xì)節(jié)的極致理解,在多項(xiàng)測試中超越谷歌、Meta同類產(chǎn)品,成為全球最強(qiáng)的視覺語言模型。

FG-CLIP2的核心突破在于解決了“細(xì)粒度識別”問題。這對于正處風(fēng)口的具身智能和商業(yè)智能化至關(guān)重要。想象一下,家庭機(jī)器人能根據(jù)“拿起茶幾上屏幕有裂痕的手機(jī)”這樣的指令準(zhǔn)確行動;安防系統(tǒng)能通過“尋找戴黑色鴨舌帽的可疑人員”瞬間鎖定目標(biāo)。FG-CLIP2讓機(jī)器對世界的理解從“大概”變?yōu)椤熬_”,為真正的實(shí)用化AI奠定了基礎(chǔ)。

作為國內(nèi)較早布局人工智能的企業(yè),360依托搜索、瀏覽器等核心業(yè)務(wù)積累的百億級圖文數(shù)據(jù),以及自研的大規(guī)模高質(zhì)量數(shù)據(jù)集FineHARD,深耕AI底層能力,持續(xù)推進(jìn)中國構(gòu)建自主可控的AI技術(shù)體系。(古雨)

【責(zé)任編輯:馬芮】

- 2026中國品牌出海·環(huán)球行(南美站)活動在巴西圣保羅舉辦

- 周鴻祎委員關(guān)注數(shù)據(jù)流通安全治理 為數(shù)據(jù)要素市場筑牢安全底座

- 讀懂一號文件“農(nóng)”情厚意

- HyperGLLM論文入選AAAI 2026:360集團(tuán)AI安全研究再獲國際頂會認(rèn)可

- AI創(chuàng)意長圖:以奮斗為筆,繪最美中國

- 中國正能量|逐夢前行,展現(xiàn)奮進(jìn)中國多維度之美

- Sandriver沙涓七度亮相M&O 攜非遺復(fù)興成果邁向全球化新程

- 2025繪夢天工開物 | 大國工程見證中國重塑山河

- COBIS國際小學(xué)運(yùn)動會首次登陸海南自貿(mào)港

- 中東沖突沖擊美國經(jīng)濟(jì) 戰(zhàn)爭前6天已花納稅人113億美元

- 飛馳嘉定

- 馬年好禮:一張千年紙,一只守護(hù)兔

- 悉尼舉辦“你好!中國”旅游推介會 展示中國旅游便利化服務(wù)

- 國際能源署:全球石油市場面臨史上最嚴(yán)重供應(yīng)梗阻

- F1紅牛車隊(duì)CEO:中國車迷正變得更年輕多元

換一批

- 違法和不良信息舉報

- 互聯(lián)網(wǎng)新聞信息服務(wù)許可證10120170006

- 信息網(wǎng)絡(luò)傳播視聽節(jié)目許可證0108263號

- 京公網(wǎng)安備11010502032503號

- 京網(wǎng)文[2011]0283-097號

- 京ICP備13028878號-6

中國日報網(wǎng)版權(quán)說明:凡注明來源為“中國日報網(wǎng):XXX(署名)”,除與中國日報網(wǎng)簽署內(nèi)容授權(quán)協(xié)議的網(wǎng)站外,其他任何網(wǎng)站或單位未經(jīng)允許禁止轉(zhuǎn)載、使用,違者必究。如需使用,請與010-84883777聯(lián)系;凡本網(wǎng)注明“來源:XXX(非中國日報網(wǎng))”的作品,均轉(zhuǎn)載自其它媒體,目的在于傳播更多信息,其他媒體如需轉(zhuǎn)載,請與稿件來源方聯(lián)系,如產(chǎn)生任何問題與本網(wǎng)無關(guān)。

版權(quán)保護(hù):本網(wǎng)登載的內(nèi)容(包括文字、圖片、多媒體資訊等)版權(quán)屬中國日報網(wǎng)(中報國際文化傳媒(北京)有限公司)獨(dú)家所有使用。 未經(jīng)中國日報網(wǎng)事先協(xié)議授權(quán),禁止轉(zhuǎn)載使用。給中國日報網(wǎng)提意見:rx@chinadaily.com.cn